前言

本文將介紹如何使用ONNX將PyTorch中訓練好的模型(.pt、.pth)型轉換為ONNX格式,然後將其加載到Caffe2中。需要安裝好onnx和Caffe2。

PyTorch及ONNX環境準備

為了正常運行ONNX,我們需要安裝最新的Pytorch,你可以選擇源碼安裝:

git clone --recursive https://github.com/pytorch/pytorch cd pytorch mkdir build && cd build sudo cmake .. -DPYTHON_INCLUDE_DIR=/usr/include/python3.6 -DUSE_MPI=OFF make install export PYTHONPATH=$PYTHONPATH:/opt/pytorch/build

其中 "/opt/pytorch/build"是前面build pytorch的目。

or conda安裝

conda install pytorch torchvision -c pytorch

安裝ONNX的庫

conda install -c conda-forge onnx

onnx-caffe2 安裝

pip3 install onnx-caffe2

Pytorch模型轉onnx

在PyTorch中導出模型通過跟蹤工作。要導出模型,請調用torch.onnx.export()函數。這將執行模型,記錄運算符用於計算輸出的軌跡。因為_export運行模型,我們需要提供輸入張量x。

這個張量的值並不重要; 它可以是圖像或隨機張量,只要它是正確的大小。更多詳細信息,請查看torch.onnx documentation文檔。

# 輸入模型 example = torch.randn(batch_size, 1, 224, 224, requires_grad=True) # 導出模型 torch_out = torch_out = torch.onnx.export(model, # model being run example, # model input (or a tuple for multiple inputs) "peleeNet.onnx", verbose=False, # store the trained parameter weights inside the model file training=False, do_constant_folding=True, input_names=['input'], output_names=['output'])

其中torch_out是執行模型後的輸出,通常以忽略此輸出。轉換得到onnx後可以使用OpenCV的 cv::dnn::readNetFromONNX or cv::dnn::readNet進行模型加載推理了。

還可以進一步將onnx模型轉換為ncnn進而部署到移動端。這就需要ncnn的onnx2ncnn工具了.

編譯ncnn源碼,生成 onnx2ncnn。

其中onnx轉換模型時有一些冗餘,可以使用用工具簡化一些onnx模型。

pip3 install onnx-simplifier

簡化onnx模型

python3 -m onnxsim pnet.onnx pnet-sim.onnx

轉換成ncnn

onnx2ncnn pnet-sim.onnx pnet.param pnet.bin

ncnn 加載模型做推理

Pytorch模型轉torch script

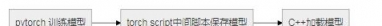

pytorch 加入libtorch前端處理,集體步驟為:

以mtcnn pnet為例

# convert pytorch model to torch script # An example input you would normally provide to your model's forward() method. example = torch.rand(1, 3, 12, 12).to(device) # Use torch.jit.trace to generate a torch.jit.ScriptModule via tracing. traced_script_module = torch.jit.trace(pnet, example) # Save traced model traced_script_module.save("pnet_model_final.pth")

C++調用如下所示:

#include// One-stop header. #include#includeint main(int argc, const char* argv[]) { if (argc != 2) { std::cerr << "usage: example-app"; return -1; } // Deserialize the ScriptModule from a file using torch::jit::load(). std::shared_ptrmodule = torch::jit::load(argv[1]); assert(module != nullptr); std::cout << "ok "; } [zhang3221994 ] Pytorch轉onnx、torchscript方式已經有355次圍觀